LONDON — Ang AI fakery ay mabilis na nagiging isa sa pinakamalaking problemang kinakaharap natin online. Ang mga mapanlinlang na larawan, video, at audio ay dumarami bilang resulta ng pagtaas at maling paggamit ng mga tool sa pagbuo ng artificial intelligence.

Sa pag-crop ng AI deepfakes halos araw-araw, na naglalarawan sa lahat mula Taylor Swift hanggang Donald Trump, nagiging mas mahirap sabihin kung ano ang totoo at kung ano ang hindi. Ginagawang madali ng mga generator ng video at larawan tulad ng DALL-E, Midjourney at OpenAI’s Sora para sa mga taong walang anumang teknikal na kasanayan na lumikha ng mga deepfakes — mag-type lang ng kahilingan at ilalabas ito ng system.

BASAHIN: Si Pope Francis, biktima ng AI, ay nagbabala laban sa mga ‘perverse’ na panganib nito

Ang mga pekeng larawang ito ay maaaring mukhang hindi nakakapinsala. Ngunit magagamit ang mga ito para magsagawa ng mga scam at pagnanakaw ng pagkakakilanlan o propaganda at manipulasyon sa halalan.

Narito kung paano maiwasan na malinlang ng mga deepfakes:

Paano makita ang isang deepfake

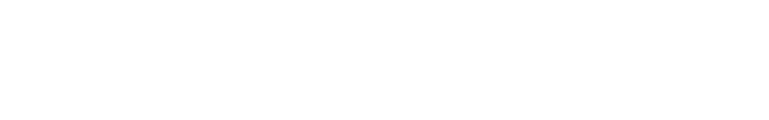

Sa mga unang araw ng deepfakes, ang teknolohiya ay malayo sa perpekto at kadalasang nag-iiwan ng mga palatandaan ng pagmamanipula. Itinuro ng mga fact-checker ang mga larawang may halatang pagkakamali, tulad ng mga kamay na may anim na daliri o salamin sa mata na may iba’t ibang hugis na lente.

Ngunit habang ang AI ay bumuti, ito ay naging mas mahirap. Ang ilang malawak na ibinahaging payo – tulad ng paghahanap ng mga hindi natural na blinking pattern sa mga tao sa mga deepfake na video – ay hindi na hawak, sabi ni Henry Ajder, tagapagtatag ng consulting firm na Latent Space Advisory at isang nangungunang eksperto sa generative AI.

Gayunpaman, may ilang mga bagay na dapat hanapin, aniya.

Maraming AI deepfake na larawan, lalo na ng mga tao, ang may electronic na ningning sa kanila, “isang aesthetic na uri ng smoothing effect” na nag-iiwan sa balat na “nakikitang hindi kapani-paniwalang pinakintab,” sabi ni Ajder.

BASAHIN: Ang maling impormasyon at deepfakes ay lumalaganap habang nagpapatuloy ang pagsasama ng AI sa pamamahayag

Nagbabala siya, gayunpaman, na ang malikhaing pag-udyok ay maaaring maalis kung minsan ito at maraming iba pang mga palatandaan ng pagmamanipula ng AI.

Suriin ang pagkakapare-pareho ng mga anino at pag-iilaw. Kadalasan ang paksa ay nasa malinaw na pokus at mukhang nakakumbinsi na parang buhay ngunit ang mga elemento sa backdrop ay maaaring hindi masyadong makatotohanan o pulido.

Tingnan ang mga mukha

Ang face-swapping ay isa sa pinakakaraniwang deepfake na pamamaraan. Pinapayuhan ng mga eksperto na tingnang mabuti ang mga gilid ng mukha. Ang kulay ba ng balat ng mukha ay tumutugma sa natitirang bahagi ng ulo o katawan? Matalim ba o malabo ang mga gilid ng mukha?

Kung pinaghihinalaan mo ang video ng isang taong nagsasalita ay nadoktor, tingnan ang kanilang bibig. Ang kanilang mga galaw sa labi ay ganap na tumutugma sa audio?

Iminungkahi ni Ajder na tumingin sa mga ngipin. Malinaw ba ang mga ito, o malabo ba sila at kahit papaano ay hindi pare-pareho sa hitsura nila sa totoong buhay?

Sinabi ng kumpanya ng Cybersecurity na si Norton na ang mga algorithm ay maaaring hindi pa sapat na sopistikado upang makabuo ng mga indibidwal na ngipin, kaya ang kakulangan ng mga balangkas para sa mga indibidwal na ngipin ay maaaring maging isang palatandaan.

Isipin ang mas malaking larawan

Minsan mahalaga ang konteksto. Magmadali upang isaalang-alang kung ang iyong nakikita ay kapani-paniwala.

Ang website ng Poynter journalism ay nagpapayo na kung makakita ka ng isang pampublikong pigura na gumagawa ng isang bagay na tila “pinalabis, hindi makatotohanan o hindi sa karakter,” maaari itong maging isang malalim na peke.

Halimbawa, ang papa ba ay talagang nakasuot ng marangyang puffer jacket, gaya ng inilalarawan ng isang kilalang-kilala na pekeng larawan? Kung gagawin niya, hindi ba magkakaroon ng mga karagdagang larawan o video na nai-publish ng mga lehitimong mapagkukunan?

Paggamit ng ai upang mahanap ang mga pekeng

Ang isa pang diskarte ay ang paggamit ng AI upang labanan ang AI.

Ang Microsoft ay bumuo ng isang authenticator tool na maaaring magsuri ng mga larawan o video upang magbigay ng marka ng kumpiyansa kung ito ay manipulahin. Gumagamit ang Chipmaker Intel’s FakeCatcher ng mga algorithm upang pag-aralan ang mga pixel ng isang imahe upang matukoy kung ito ay totoo o peke.

May mga tool online na nangangako na maamoy ang mga pekeng kung mag-a-upload ka ng file o mag-paste ng link sa kahina-hinalang materyal. Ngunit ang ilan, tulad ng authenticator ng Microsoft, ay magagamit lamang sa mga piling kasosyo at hindi sa publiko. Iyon ay dahil ayaw ng mga mananaliksik na magbigay ng tip sa mga masasamang aktor at bigyan sila ng mas malaking kalamangan sa deepfake arms race.

Ang bukas na pag-access sa mga tool sa pag-detect ay maaari ding magbigay sa mga tao ng impresyon na sila ay “mga maka-diyos na teknolohiya na maaaring mag-outsource ng kritikal na pag-iisip para sa atin” ngunit sa halip ay kailangan nating malaman ang kanilang mga limitasyon, sabi ni Ajder.

Ang mga hadlang sa paghahanap ng mga pekeng

Lahat ng ito ay sinasabi, ang artificial intelligence ay sumusulong nang may napakabilis na bilis at ang mga modelo ng AI ay sinasanay sa data ng internet upang makagawa ng mas mataas na kalidad na nilalaman na may mas kaunting mga bahid.

Nangangahulugan iyon na walang garantiya na magiging wasto pa rin ang payong ito kahit isang taon mula ngayon.

Sinasabi ng mga eksperto na maaari pa ngang mapanganib na ilagay ang pasanin sa mga ordinaryong tao na maging mga digital na Sherlock dahil maaari itong magbigay sa kanila ng maling kumpiyansa dahil lalong nagiging mahirap, kahit para sa mga sinanay na mata, na makakita ng mga deepfakes.