MANILA, Philippines – Walang pagtanggi na ang Artipisyal na Intelligence (AI) ay narito upang manatili sa modernong lugar ng trabaho. Sa gitna ng mabilis na pag -aampon na ito, ang mga katanungan sa etika ng AI, responsableng paggamit at pagsunod sa mga regulasyon ng gobyerno ay hindi madalas na tinalakay.

Halimbawa, si Ken Suarez, isang tagapamahala ng produkto mula sa Nueva Ecija, ay nagsabi na ang AI ay nakatulong sa kanya na magsagawa ng simple ngunit paulit-ulit at oras na mga gawain.

“Ito ay pandagdag sa aking kaalaman at kasanayan,” sabi niya sa Inquirer. “Dahil ang aking larangan ay may kaugnayan sa teknolohiya, lubos kaming hinihikayat na gumamit ng AI dahil sinusubukan naming magamit at galugarin ang lawak kung saan maaaring magamit ito.”

Sa ngayon, ito ay mabuti sa mga gawain na maaaring magamit ang malawak na data ng pagsasanay na ginamit ng mga modelo ng AI, paliwanag ni Suarez. Ngunit kinukuha niya ang gawain ng AI na may isang butil ng asin.

“Maaari mong isaalang -alang ang AI bilang iyong junior sa trabaho, kaya sinusuri mo kung okay ba ang kanilang trabaho. Ito ay etikal kung gumagamit kami ng AI bilang isang tool at mayroon kaming nararapat na pagsisikap upang suriin ang output nito,” sabi ni Suarez.

Alamin ang iyong mga limitasyon

Alam din niya ang mga limitasyon na dapat ilagay ang isa kapag gumagamit ng AI para sa trabaho. “Magkakaroon lamang ng mga panganib kung wala kang nararapat na sipag sa pagtanggal ng pribadong impormasyon. Ito ay sa mga tuntunin at kundisyon ng AI o malalaking mga modelo ng wika na maaari nilang gamitin ang mga bagay na iyong input para sa pagsasanay,” paliwanag niya.

“Bagaman sasabihin nila na gagamitin nila (ang iyong data) nang responsable, Mabuti Nang Sigurado (mas mahusay na matiyak),” dagdag niya.

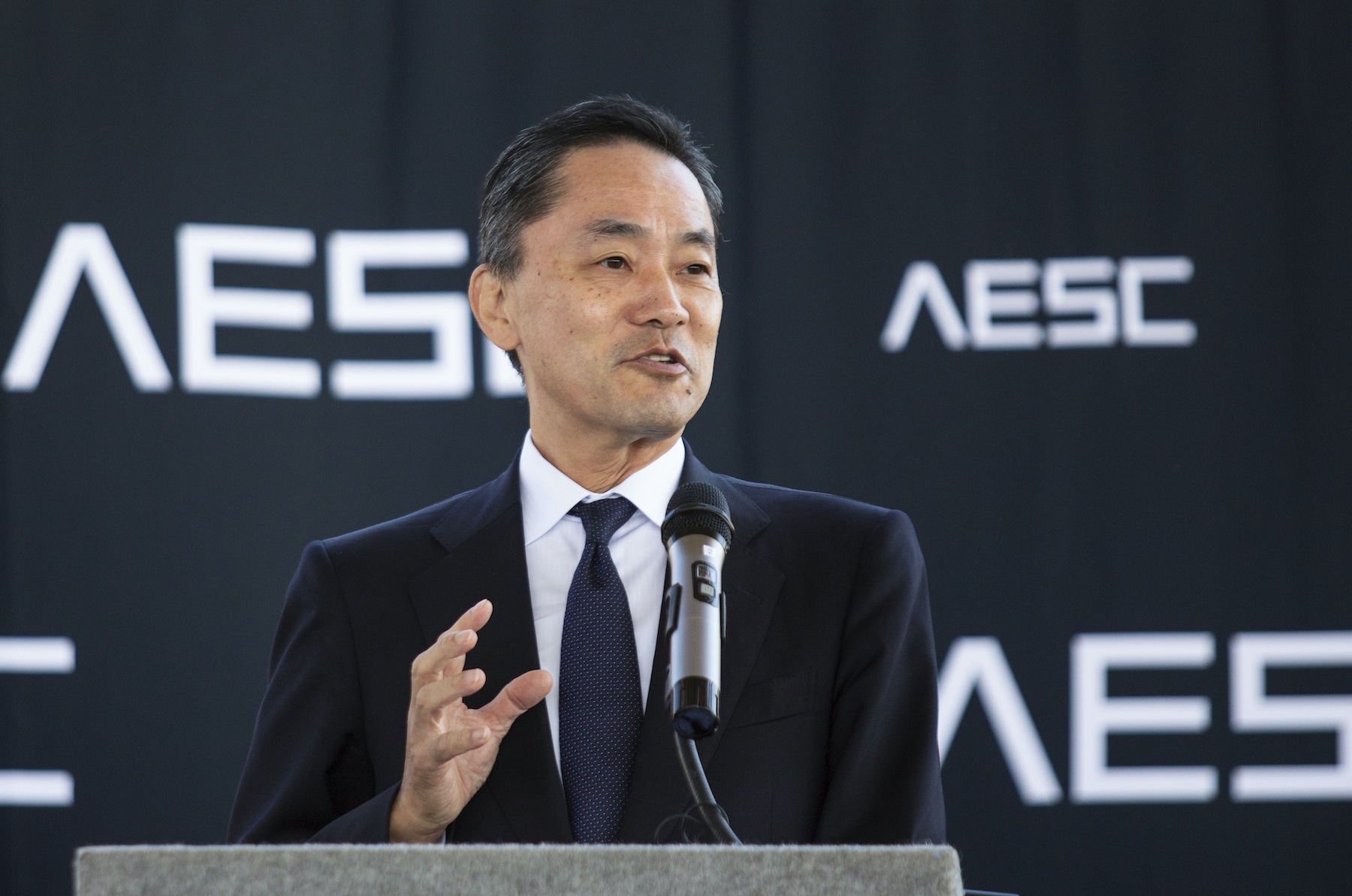

Tiyak, ang mga katulad na talakayan ay patuloy sa mga silid -aralan at tanggapan sa buong mundo. Ang mga kumpanya ay dapat magkaroon ng kamalayan sa mga posibleng panganib, etikal na pagsasaalang-alang at responsibilidad na bahagi at bahagi ng paggamit ng AI, sabi ni Alvin Toh, cofounder at punong marketing officer ng Singapore na nakabase sa Straits Interactive.

Itinatag noong 2013, inilarawan ng Straits Interactive ang sarili bilang isang kumpanya ng teknolohiyang pang-edukasyon na nagbibigay ng mga serbisyo tulad ng pagsasanay sa AI-enhanced at dalubhasa sa pagpapayo sa proteksyon ng data at pamamahala.

Kamakailan lamang ay nag-debut ng Capabara, isang software na may kakayahan-as-a-service na tumutulong sa mga institusyon na bumuo ng mga bagong tool na AI, tulad ng mga isinapersonal na tutor ng AI o chatbots.

Ang AI ay nasa lahat ng dako

Sinabi ni Toh na ang mga organisasyon ay marami upang malaman ang tungkol sa mga panganib na naroroon sa bawat yugto ng AI lifecycle, at napansin niya na ang mga pinuno ng negosyo at mga propesyonal ay may iba’t ibang antas ng pag -unawa tungkol sa mga isyung ito.

Habang ang ilan ay sinasadya sa pagtatakda ng kanilang sariling mga patakaran sa AI – halimbawa, pag -iwas sa mga libreng bersyon ng mga modelo ng AI upang maiwasan ang pagtagas ng data at paggamit para sa pagsasanay sa modelo – ang ilan ay hindi rin alam ang mga panganib na ito.

“Ang ilan ay nagkakamali na naniniwala na hindi nila kailangang mag -alala tungkol sa mga panganib sa AI dahil hindi nila pormal na ipinatupad ang Generative AI – na mapagtanto na marami sa kanilang mga empleyado ay maaaring tahimik na gumagamit ng mga tool na magagamit sa publiko sa mga paraan na hindi nakakasama sa mga patakaran sa korporasyon,” paliwanag ni Toh sa Inquirer sa isang pakikipanayam sa email.

Sinabi niya na kung ang mga negosyo ay aktibong nag -deploy ng AI o hindi, ang mga tool na Generative AI ay naka -embed sa mga karaniwang ginagamit na aplikasyon upang mapalakas ang pagiging produktibo, tulad ng henerasyon ng teksto, pagsusuri ng data, mga buod ng pulong, transkripsyon at awtomatikong mga item ng pagkilos.

“Ang caveat ay marami sa mga tampok na pinapagana ng AI na ito ay pinagana nang default, at sa pamamagitan ng pagsang-ayon sa kanilang mga termino ng paggamit, ang mga organisasyon ay maaaring hindi sinasadya na pahintulutan ang mga modelong AI na iproseso ang kanilang data para sa karagdagang pagsasanay sa ilalim ng pretext ng ‘pagpapabuti ng mga serbisyo,'” dagdag ni Toh.

Etika, responsibilidad

Ang paggamit ng etikal at responsableng AI ay gumagamit ng intersect na may privacy at mga isyu sa paggamit ng data ngunit madalas na nakakulong sa bawat isa. Sinabi ni Toh na ang paggamit ng AI ay responsable ay upang mapagaan ang mga panganib at maiwasan ang negatibong epekto ng mga limitasyon at potensyal na pinsala ng AI, habang ang pagiging etikal ay ang pagtuon sa kung ano ang “tama sa moral” at nakahanay sa mga halaga ng lipunan.

Dahil dito, pinipilit niya ang mga katanungan tungkol sa etika ng AI sa “3 A’s,” lalo na: awtonomiya, na tinatanong kung ang sistema ay maaaring kumilos nang walang interbensyon ng tao; ahensya, o ang mga kontrol at mga limitasyon na inilagay upang maiwasan ang mga hindi kanais -nais na pagkilos ng mga developer at deployer ng AI; at katiyakan, o pagtatanong kung paano masiguro ng mga organisasyon ang kaligtasan, seguridad at pagiging mapagkakatiwalaan sa paggamit ng AI.

Samantala, mayroon ding tatlong mga katanungan sa ilalim ng “3 I’s”: mga tagapagpahiwatig, o alam kung anong sukatan ang gagamitin bilang isang bakuran sa pagsukat ng pagganap ng sistema ng AI; mga interface, o kung paano makikipag -ugnay ang mga tao sa sistema ng AI; at intensyonalidad, o kung ano ang dinisenyo na layunin ng sistema ng AI.

Inilarawan ng TOH ang pinakamalaking mga panganib sa etikal sa pag-aampon ng AI tulad ng nailalarawan sa pamamagitan ng paglawak ng mga autonomous AI system, machine bias sa mga ligal at paggawa ng desisyon, mga alalahanin sa privacy at pagsubaybay, at ang kakulangan ng transparency at pagpapaliwanag sa AI ay may mga desisyon o output nito, na mas kilala bilang “Black Box Problem.”

Mga panganib ng mga modelo ng murang gastos

Posibleng mapabilis ang pag-aampon ng AI ay bago, mga murang mga modelo tulad ng kung ano ang naipakita ng China Tech Startup Deepseek nang mas maaga sa taong ito, ang isa na nagpakita ng mga katulad na kakayahan sa kasalukuyang mga modelo ngunit binuo sa isang maliit na bahagi ng gastos na may mas mababang pagganap na hardware.

Sinabi ni Toh na habang ang pagpasok ng Deepseek ay naghahamon sa tradisyonal na dinamika sa merkado at nagpapababa ng mga hadlang sa pagpasok sa sektor ng AI, binibigyang diin din nito ang mga hamon at isyu.

Ipinaliwanag niya na ang mga organisasyon ay maaaring magpatupad ng mga modelo ng DeepSeek nang walang kadalubhasaan sa kaligtasan ng AI, tulad ng ebidensya ng isang Straits Interactive na pag -aaral ng pananaliksik na nagpapakita ng maraming mga startup ng AI na nagpapauna sa mabilis na pagpasok sa merkado sa mga pagsasaalang -alang sa privacy at seguridad.

Gayundin, ang mga negosyo ay maaaring ilantad ang kanilang mga sarili sa hindi sinasadyang pinsala, lalo na sa mga sektor tulad ng pangangalaga sa kalusugan, pananalapi at mga mapagkukunan ng tao kung saan ang “mga desisyon na pinapagana ng AI ay maaaring makabuluhang makakaapekto sa mga indibidwal.”

Karamihan sa kritikal, sinabi ni Toh na ang mga modelo ng self-host na AI ay maaaring madaling kapitan ng pagkalason ng data, kung saan nakompromiso ang mga datasets ng pagsasanay sa AI; Prompt injection, kung saan ang mga nakakahamak na input ay ginagamit upang manipulahin ang mga sistema ng AI sa hindi sinasadyang pag -uugali; at hindi awtorisadong pag -tampe. Maaari itong magamit ng mga nakakahamak na aktor upang samantalahin ang mga sistema ng AI o mga kampanya ng maling impormasyon.

“Ang Deepseek ay kumakatawan sa parehong pangako ng naa -access na AI at ang kahalagahan para sa kaukulang mga istruktura ng pamamahala,” sabi ni Toh.

Pagbalanse ng pagbabago, pananagutan

Tulad nito, inirerekomenda ng TOH na ang mga organisasyon ay nagkakaroon ng mga pamantayan sa industriya para sa mga bukas na mapagkukunan na pagpapatupad ng AI na nagtatag din ng mga kinakailangan sa kaligtasan at etikal at nagbibigay ng mas maraming mga pagkakataon para sa mga propesyonal na malaman ang etika ng AI.

Bilang karagdagan, sinabi niya na ang mga regulasyon na mga frameworks ay mahalaga sa pagbabalanse ng pagbabago na may kaligtasan, bukod sa pag -utos ng transparency tungkol sa mga kakayahan, mga limitasyon ng AI, mga patakaran sa paggamit ng data.

“Habang patuloy na pinagtibay ng mga organisasyon ang mga modelong ito, ang pamayanan ng AI ay dapat gumana nang sama-sama upang matiyak na ang pag-unlad ng teknikal na pagsulong sa tabi ng mga pagsasaalang-alang sa etikal at mga responsableng kasanayan sa paglawak,” paliwanag niya.

Dapat suriin ng mga negosyo ang mga patakaran sa privacy, mga setting ng seguridad at mga termino ng paggamit ng mga pagsasama ng AI na pinapagana sa kanilang mga system, na nakatuon sa kung anong data ang nakolekta, kung paano naproseso at nakaimbak ang mga ito, at kung ang mga modelo ng AI ay sinanay gamit ang data ng organisasyon.

Ang mga platform, tulad ng Straits Interactive’s Capabara, ay maaari ring makatulong sa pagpapanatili ng pagsunod sa mga frameworks ng pamamahala ng AI, pagbuo ng tiwala at pagbibigay kapangyarihan sa mga gumagamit.

Regulasyon ng Pamahalaan

Basahin: Pamamahala ng AI: Ang paraan ng pasulong sa Pilipinas

Sa tabi ng mga pagsisikap ng pribadong sektor, itinatampok ng TOH na mayroon ding mga aksyon ng gobyerno upang ipakilala ang mga frameworks ng pamamahala ng AI, kasama ang European Union (kasama ang EU AI Act) at ang pamahalaang South Korea (kasama ang pangunahing Batas na itinakda upang ipatupad noong Enero) na nagtatakda ng mahigpit na mga regulasyon upang matiyak ang pananagutan.

“Sa isip, dapat ipatupad ng mga gobyerno ang mga regulasyon sa kaligtasan ng AI habang pinapayagan ang silid para sa responsableng pagbabago,” sabi niya.

Sa Pilipinas, napansin ni Toh na ang House Bill (HB) No. 10944, na isinampa ni Caloocan Rep. Mary Mitzi Cajayon-Uy, ay nagbibigay ng mahalagang pananaw sa tilapon ng regulasyon sa bansa.

Ang HB 10944, bukod sa iba pang mga bagay, ay nagmumungkahi ng isang Philippine Artipisyal na Intelligence Board, isang database ng mga laboratoryo ng AI at mga kumpanya sa bansa at matigas na parusa para sa mga paglabag.

“Bagaman maaga pa upang sabihin kung sapat na ang mga hakbang na ito, tiyak na bahagi ito ng pangako ng gobyerno upang matiyak na ang AI ay ipinatupad sa isang responsable at etikal na paraan,” komento ni Toh.